پایگاه خبری راه پرداخت دارای مجوز به شماره ۷۴۵۷۲ از وزارت فرهنگ و ارشاد اسلامی و بخشی از «شبکه عصر تراکنش» است. راه پرداخت فعالیت خود را از دوم اردیبهشتماه ۱۳۹۰ شروع کرده و اکنون پرمخاطبترین رسانه ایران در زمینه فناوریهای مالی، بانکداری و پرداخت و استارتآپهای فینتک است.

اگر هوشمندانه عمل کنیم، هوش مصنوعی میتواند بهترین اتفاق برای بشریت باشد

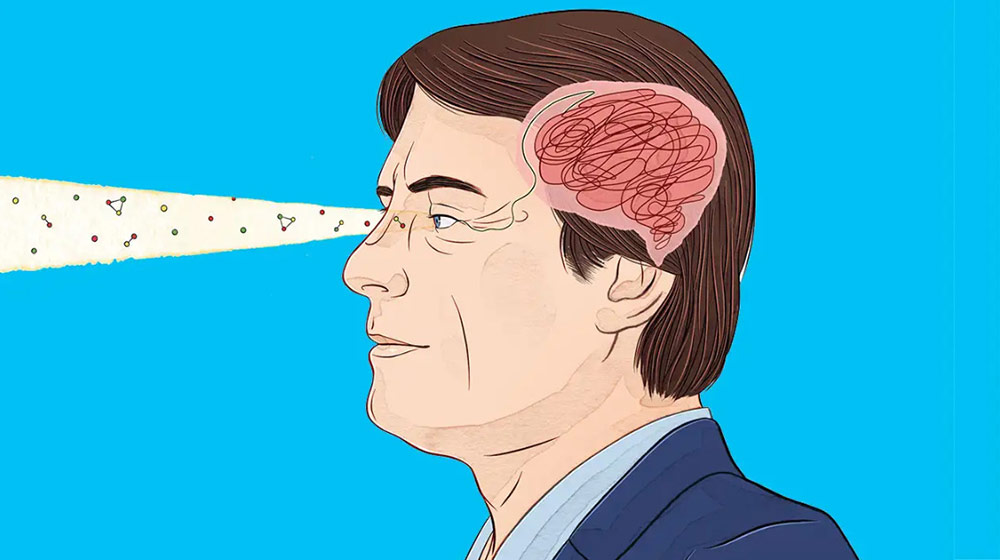

مکس تگمارک که زمانی بهدنبال آشکار کردن اسرار فرضیه چندجهانی بود، اکنون توجهش به هوش مصنوعی جلب شده است. ریچارد وب با تمارگ در مورد کیهانشناسی، خودآگاهی و تلاش برای بهرهمندی همه از هوش مصنوعی گفتوگو کرده است

ماهنامه عصر تراکنش شماره ۳۷ / «همه جهانها حتی جهانهای مثلثی هم وجود دارند.» این جمله ششم ژوئن ۱۹۹۸ یعنی یکی از اولین دفعاتی که مکس تگمارک در دفتر مجله نیوساینتیست حضور یافت، روی جلد این مجله نقش بست. مکس تگمارک که در آن زمان ۳۱ سال داشت، در آن شماره ایده جسورانهاش در مورد نظریه چندجهانی را تشریح کرد که طبق آن همه جهانهایی که از لحاظ منطقی محتمل هستند، نهتنها وجود دارند؛ بلکه باید وجود داشته باشند.

تگمارک که اکنون استاد مؤسسه فناوری ماساچوست (امآیتی) است، بهواسطه ایدههای بحثبرانگیزش شناخته میشود. همانطور که در بخش «عجیبوغریب» وبسایتش توضیح میدهد: «هر وقت 10 مقاله عادی مینویسم، به خودم اجازه میدهم یک مقاله دیوانهوار نیز بنویسم.» اما اظهارات و مقالات عجیب او نباید روی سابقه جدیاش در کیهانشناسی، علوم اطلاعات کوانتومی و بررسی شماری از عمیقترین پرسشهای مربوط به ماهیت واقعیت سایه بیندازند.

تگمارک بهتازگی روی هوش، هم انسانی و هم مصنوعی، متمرکز شده است. در مورد هوش مصنوعی پژوهشهای پیشگامی انجام میدهد و این اواخر با «سیلویو ماریان یودرسکو»، همکار پژوهشگرش در امآیتی، همکاری کرده است تا هوشی مصنوعی ایجاد کنند که میتواند برخی از بنیادیترین معادلات فیزیک را با بررسی الگوهای دادهها از نو کشف کند. تگمارک در سال ۲۰۱۴ مؤسسه «آینده زندگی» Future of Life را همبنیانگذاری کرد که هدفش درک و کاهش ریسکهای مربوط به موجودیت انسان، بهویژه ریسکهای ناشی از ظهور هوش مصنوعی است.

چه مسئلهای باعث شد از کیهانشناسی به هوش مصنوعی روی بیاورید؟

پرسشهای بزرگ همواره برایم جذاب بودهاند، هرچه بزرگتر باشند، بهتر است. به همین دلیل به مطالعه کائنات علاقهمند بودم؛ چراکه شامل پرسشهای فلسفی بزرگی مثل «منشاء همه چیز کجاست»، «چه اتفاقی میافتد»، «جایگاه ما در این دنیای بزرگ کجاست» و مانند آنها میشود. پیشرفت چشمگیری در کیهانشناسی داشتهایم، اما همزمان دادههای واقعاً جدید، کمیابتر و دستیابی به آنها دشوارتر شده است.

بنابراین بسیار طبیعی بود که به سمت بزرگترین معمای حلنشدهای جذب شوم که بهنوعی در دسترس قرار دارد. با تلسکوپها میتوانیم چیزهایی را ببینیم که در گذشته هرگز نمیتوانستیم. اکنون همین اتفاق در مورد ذهن هم افتاده است. از طریق علوم اعصاب دادههای بسیار زیادی به دست آوردهایم و به توانایی ساخت نسخههای مصنوعی از مقولههایی دست یافتهایم که میخواهیم مطالعه کنیم.

در حال حاضر روی چه مسئلهای کار میکنید؟

تحقیقات من بر مقولهای متمرکز است که آن را «یادگیری ماشین در راه نیک» میخوانم. بهتازگی تلاش زیادی در مورد پروژهای انجام دادهایم که از یادگیری ماشین برای شناسایی سوگیری خبری استفاده میکند. از کیفیت خبر در ایالات متحده بسیار ناراضیام و با خودم عهد بستهام که دیگر در مورد مسئلهای گله و شکایت نکنم، مگر اینکه خودم زمانی را برای بهبود وضعیت آن صرف کرده باشم.

هوش مصنوعی چطور میتواند سوگیری خبر را کاهش دهد؟

پروژههایی وجود دارند که با استفاده از افرادی که مطالب را راستیآزمایی و مشکلات را نشاندار میکنند، بهدنبال بهبود کیفیت خبر هستند، اما اگر بیشتر توجه کنید، میبینید که برخی سایتهای راستیآزمایی 95 درصد خطاها را در رسانههای چپگرای طیف سیاسی و برخی دیگر فقط خطاهای رسانههای راستگرا را پیدا میکنند. در حقیقت دقیقاً مشخص نیست از چه معیارهایی استفاده میکنند.

ما تصمیم گرفتیم سیستمی کاملاً خودکار بسازیم. هنوز پروژه کاملی نیست، اما از یادگیری ماشین برای طبقهبندی مقالهها و گزارشها بر اساس سنجههای متفاوت مثل موضوع، چپ یا راست بودن، موافق یا مخالف تشکیلات بودن، عمیق یا سطحی بودن و التهابزا یا ظریف بودن استفاده میکنیم. این ابزار کمی شبیه گوگلنیوز است، اما چند دکمه و اهرم در آن تعبیه شده تا خواننده بتواند تنظیمات مورد نظرش را در آن اعمال کند.

آیا این کار ریسک تقویت اثر «اتاق پژواک» را در پی ندارد و باعث نمیشود افراد انتخاب کنند فقط خبرهایی را ببینند که با سوگیریهایشان همسو است؟

شرایط موجود دقیقاً به همین شکل است. اگر به فیسبوک مراجعه کنید، کاملاً اتاق پژواک شما را تقویت میکند. پرسش این است که اگر فرصتی به دست بیاورید که بتوانید به جای مطالعه نسنجیده و بدون فکر، انتخابهای کمی سنجیدهتری داشته باشید، آیا این اتفاق شرایط را بهتر میکند یا بدتر؟

دیوید رند، استاد روانشناسی امآیتی آزمایشهای بسیار جالبی انجام داده که نشان میدهد این تفکر که افراد فقط میخواهند مطالب موافق عقایدشان را بخوانند تا حدودی اشتباه است. افراد به شنیدن سایر دیدگاهها هم علاقه دارند؛ البته به شرط آنکه بهصورت ظریفی ارائه شوند. میتوانیم با استفاده از یادگیری ماشین بفهمیم کدام مقالات ظریف هستند و کدام مقالات احتمالاً فقط افراد را عصبانی میکنند. امیدوارم به گونهای نباشد که کاربران ترجیحهایشان را یک بار تنظیم کنند و بعد دیگر به آنها دست نزنند؛ بلکه کمی کنجکاو باشند.

هدف کلیتر «یادگیری ماشین در راه نیک» چیست؟

فکر میکنم چالش بنیادین ما در برخورد با هوش مصنوعی و بهطور کلی فناوری، پیروز شدن در نبرد خرد است. باید مطمئن شویم که قدرت فناوری سریعتر از خردی رشد نمیکند که با آن مدیریتش میکنیم.

از دیرباز با یادگیری از اشتباهات توانستهایم از فناوری جلوتر باشیم. آتش را اختراع کردیم، چند بار خرابکاری کردیم و بعد کپسول آتشنشانی، سازمان آتشنشانی و زنگ خطر آتشسوزی را ابداع کردیم. خودرو را اختراع کردیم و بعد کمربند ایمنی، کیسه هوا، چراغ راهنمایی و قوانین مخالف سرعت غیرمجاز را به وجود آوردیم.

چالش ما این است که وقتی قدرت فناوری از آستانه ویژهای عبور میکند، درسگرفتن از اشتباهات دیگر ایده خوبی نیست. نمیخواهیم یک جنگ اتمی اتفاقی بین ایالات متحده و روسیه به وقوع بپیوندد و بعد از هزاران انفجار بگوییم: «ای وای! حالا بیایید از اشتباهاتمان درس بگیریم». در مورد زیستشناسی مصنوعی و همچنین هوش مصنوعی در حالی که به تواناییهای انسانی نزدیک میشود، همین مسئله را مشاهده میکنیم. این مسئله تمرکز اصلی پژوهش من است؛ اینکه چطور میتوانیم هوش مصنوعی واقعاً قابل اعتمادی بسازیم؟

چرا مسئله اعتماد به هوش مصنوعی بسیار مهم است؟

بزرگترین پیشرفت یادگیری ماشین در سالهای اخیر ناشی از شبکههای عصبی مصنوعی بوده که میتوانند کارهای فوقالعاده هوشمندانهای انجام دهند؛ مثلاً، همه افراد زمین را در شطرنج یا بازی «گو» شکست بدهند، اما درک و دانش کمی از سازوکار این نوع هوش مصنوعی داریم. اغلب با آن بهعنوان جعبه سیاه برخورد میکنیم و بعد هر چند وقت یکبار میبینیم که طبق انتظار ما رفتار نمیکند. برای مثال مشکلاتی از این دست داریم که بوئینگ واقعاً دوست دارد نحوه کار سیستم خودکار سری ۷۳۷ را بهتر درک کند یا شرکت معاملاتی «نایت کپیتال» دوست داشت قبل از اینکه سیستم معاملات خودکارش به مدت ۴۴ دقیقه هر دقیقه ۱۰ میلیون دلار از دست بدهد، بداند این سیستم چطور کار میکند.

دادگاههایی را هم در سراسر ایالات متحده داشتیم که از نرمافزاری برای پیشنهاد ارائه یا عدم ارائه عفو مشروط به افراد استفاده میکردند. افراد واقعاً نمیدانستند این نرمافزار چطور کار میکند و متوجه نبودند که سوگیری نژادی دارد. در گروهمان در حال توسعه روشهایی هستیم که به افراد این امکان را میدهد که داخل جعبه سیاه را ببینند و درک کنند هوش مصنوعی دقیقاً چه کار میکند. فکر میکنم اگر افراد بتوانند از این روشها استفاده کنند، شرایط احتمالاً بهتر خواهد شد.

به نظر میرسد از آن دسته افراد خوشبین به فناوری هستید.

آیا از آن دسته افرادی هستید که فکر میکنند آتش میتواند افراد را بکشد یا از آن دستهای هستید که فکر میکنند آتش افراد را در زمستان گرم نگه میدارد؟ بدیهی است که هر دو اتفاق میافتد.

مسئله اصلی ارائه استدلال موافق یا مخالف آتش نیست، مسئله اصلی پیدا کردن راهی برای مدیریت هوشمندانه آتش است. فناوری خیر یا شر مطلق نیست، ابزاری خنثی نسبت به اصول اخلاقی است که میتواند به شما امکان انجام کار خیر یا شر را بدهد. در حال حاضر هوش مصنوعی هنوز خیلی کمهوش است، اما همین حالا هم آنقدر در دنیا تأثیرگذار بوده که باعث مشکلات زیادی مثل تصمیمات تبعیضآمیز دادگاهها و سقوط هواپیماها شده است.

فکر میکنم ساختن هوش مصنوعی بسیار قدرتمند امکانپذیر است و اگر هوشمندانه عمل کنیم، هوش مصنوعی میتواند بهترین اتفاق برای بشریت باشد؛ زیرا همه مسائلی که درباره تمدن دوست دارم، محصول هوش انسانی است. اگر بتوانیم این هوش انسانی را با هوش مصنوعی تقویت کنیم، میتوانیم از آن برای حل بحران اقلیمی، برطرفکردن معضل فقر، کشف درمان ویروس کرونا و غیره استفاده کنیم. کجای این دستاوردها بد است؟

با توجه به اینکه هنوز حتی سازوکار هوش انسان را درک نمیکنیم، آیا ساخت این نوع هوش مصنوعی «همهکاره» پیشرفته، واقعبینانه است؟

شبیه این است که بپرسید چطور ممکن است پیش از درک نحوه پرواز پرندگان بفهمیم چطور میتوان دستگاهی پرنده ساخت؟ تکامل داروینی، هم پرنده و هم حیوانات متفکر بهدنبال داشت، اما خیلی محدود بود، فقط میتوانستیم راهحلهایی داشته باشیم که خودمونتاژشونده و خودتعمیرشونده بودند، فقط از چند عنصر شیمیایی استفاده میکردند و بسیار کممصرف بودند. اگر این محدودیتهای زیستی را برطرف کنیم، اغلب میتوانیم راهحلهای بسیار سادهتری برای همان مشکلات قبلی پیدا کنیم.

میدانم که برخی افراد فکر میکنند هوش مشخصهای جادویی دارد و در نتیجه فقط میتواند در بدن انسان وجود داشته باشد. من اینطور فکر نمیکنم. من حبابی از الکترونها و کوارکها هستم که اطلاعات را با روشهای پیچیده خاصی پردازش میکنند و مسئله کلیدی در هوش ماهیت نوع پردازش اطلاعات است. حتی میتوانم پیشبینی کنم که سازوکار دقیق مغز انسان را زمانی درک خواهیم کرد که سیستمی سادهتر بسازیم که تقریباً به اندازه انسان هوشمند باشد.

از قرار معلوم نمیتوانیم هوشی مصنوعیای بسازیم که دقیقاً مثل انسانها فکر یا احساس میکند و از ویژگیهایی مثل عاملیت یا خودآگاهی برخوردار است؟

نمیتوان با قطعیت گفت. فکر میکنم مهمترین سؤال این نیست که چه اتفاقی میافتد، این است که ما میخواهیم چه اتفاقی بیفتد. شاید بهعنوان طراح انتخابهای زیادی داشته باشیم. حوزه ذهنهای مصنوعی بالقوه بسیار گستردهتر از حوزه ذهنهای زیستی است؛ چراکه همه ذهنهای زیستی تکامل یافتهاند و اغلب پیش از هر چیز غریزه بقا دارند. وقتی چنین محدودیتهایی نداشته باشید، فرصتهای بسیار بیشتری در دسترستان قرار میگیرد.

شاید بتوانیم هوشهای مصنوعی متفاوتی بسازیم که در کارهای مختلف به یک اندازه عملکردشان خوب است، اما دامنه گستردهای از تجربههای خودآگاهی دارند؛ از هیچ تا تجربهای انتزاعی که شباهت زیادی به تجربه انسان دارد و رنگها، صداها، لرزشها و حتی احساسات را تجربه میکند.

واقعاً؟ مگر میتوان سیستمی را به نحوی برنامهریزی کرد که احساسات داشته باشد؟

فکر میکنم در دادن جواب منفی به این سؤال بیش از حد به خودمان مطمئن هستیم. باید در مورد ادعاهای حقبهجانبی مثل اینکه میدانیم چه زمانی تجربه انتزاعی وجود دارد و چه زمانی وجود ندارد، بسیار مراقب باشیم. این اشتباه را در مورد حیوانات مرتکب شدیم و فکر میکنم دوباره با ماشینها هم در حال تکرار آن هستیم. بیشتر همکارانم این مسئله را بهعنوان اصلی بدیهی پذیرفتهاند که هیچکدام از ماشینهایی که میسازند، هرگز تجربهای انتزاعی نخواهند داشت، بنابراین نیازی نیست نگران رنجکشیدنشان باشند و هر وقت بخواهند میتوانند خاموش یا روشنشان کنند. به هیچوجه فکر نمیکنم این مسئله بدیهی باشد.

حدس میزنم خودآگاهی احساسی است که از پردازش اطلاعات به شیوههای پیچیده خاصی ناشی میشود. فکر میکنم دانشمندان در برابر جهان وظیفه دارند که این شیوههای پیچیده خاص را بفهمند.

منظورتان از «احساس ناشی از اطلاعات» چیست؟

بسیاری از افراد به اشتباه فرض میکنند که وقتی به اطرافشان نگاه میکنند و رنگهای متفاوتی میبینند، این تجربهها به دنیای بیرون وابسته است. برای مثال وقتی یک سیب میبینید که قرمز است و فکر میکنید فقط به این دلیل رنگ قرمز دارید که سیب وجود دارد. چنین تصوری بهوضوح اشتباه است، میتوانید خواب سیب را ببینید و باز هم در حالی که اصلاً دنیای بیرونی وجود ندارد، قرمز بودن را تجربه کنید. بنابراین وقتی نورونها پیام عصبی ارسال میکنند، اتفاقی میافتد که کاملاً درون مغز انسان قرار دارد. این اتفاق چیست؟ میخواهم این را بفهمم.

فکر میکنید زمانی برسد که به توصیفی کامل برای نحوه به وجود آمدن خودآگاهی از اتمها و مولکولها برسیم؟

هنوز در ابتدای راهیم و سرنخ چندانی نداریم و بدیهی است که باید با ذهنهای بسیار باز با این مسئله برخورد کنیم، ولی بهطور کلی خودآگاهی را آخرین سنگری میدانم که هنوز فیزیک موفق به تسخیر آن نشده است.

اکنون هوش نیز بهمرور به توصیف ریاضیاتی درآمده، درست است؟ اساس هوش مصنوعی همین است و همین حالا هم نظریههایی وجود دارند که میخواهند پیشبینی کنند کدام پردازش اطلاعات خودآگاه است و کدام نیست. حوزه بسیار مستعدی برای تحقیقات علمی است.

اما قوانین فیزیک خودشان محصول تأمل خودآگاه هستند. آیا خودآگاهی همیشه در توصیف خودش ناموفق نخواهد بود؟

بله نظر جالبی است. در واقع میپرسید آیا بخش کوچکی از یک مقوله میتواند کل آن را که شامل خودش هم میشود، توصیف کند؟ یا این کار به معنی ورود به حلقهای تکرارشونده است؟ البته نمیتوانم مطمئن باشم که میتوانیم با فیزیک یا ماشینها خودآگاهی را توصیف کنیم. افراد زیادی وجود دارند که فکر میکنند هرگز نمیتوانیم خودآگاهی را توصیف کنیم؛ چراکه شامل نوعی روح یا مقوله دیگری میشود که اساساً نمیتوان مطالعهاش کرد.

من خوشبینترم. حدس میزنم خودآگاهی را میتوان از منظر پردازش اطلاعاتی که توسط ذرات متحرک انجام میشود، بهخوبی درک کرد. اما صرفنظر از اینکه فکر میکنید با موفقیت به توصیفی برای خودآگاهی میرسیم یا خیر، راهی برای تضمین شکست این است که از ابتدا خودتان را متقاعد کنید که غیرممکن است. پس بیایید تمام تلاشمان را بکنیم. اگر موفق نشویم، باز هم بسیار جذاب خواهد بود.

چه آیندهای را برای همه این مسائل متصور هستید؟

فکر میکنم در این زمینه باید هوش و خودآگاهی را تفکیک کنیم. در زمینه هوش شک ندارم که همچنان پیشرفتمان ادامه خواهد داشت؛ مگر اینکه با نوعی خرابکاری دست به خودتخریبی بزنیم. فقط امیدوارم بعداً نگوییم کنجکاوی زیاد سرمان را به باد داد، یعنی کنجکاویمان برای فهمیدن هوش باعث نشود چیزهایی بسازیم که استفاده از آنها منقرضمان کند. به همین دلیل است که گرایش زیادی به بررسی دقیق مقوله خرد دارم که پیش از این در موردش بحث کردیم.

آیا نسبت به خطرات هوش مصنوعی آگاه و هشیار شدهایم؟

فکر میکنم بدون شک تغییرات بزرگی پدیدار شده است. در حال حاضر امکان ندارد به همایشی درباره هوش مصنوعی بروید و با چند سخنرانی در مورد امنیت، شفافیت، قابلیت تعامل و استحکام هوش مصنوعی برخورد نکنید. در جامعه هوش مصنوعی آرمانگرایی زیادی وجود دارد. به همین دلیل بسیار امیدوارم که بتوانیم از یادگیری ماشین برای توانمند کردن عموم مردم، مقاومت در برابر قدرتهای موجود و حتی گاهی اوقات از این ابزارها برای برملا کردن کارهای خلاف پنهانی استفاده کنیم.

این سخنان هم باز نشانهای از خوشبینی به فناوری است.

کلید داشتن آیندهای مطلوب این است که بتوانیم چشماندازی را مشخص کنیم که افراد از سراسر دنیا بتوانند آن را بپذیرند. با بازی مجموع صفر سروکار نداریم. بدون اغراق میتوان سناریوهایی را تصور کرد که در آنها هوش مصنوعی تولید ناخالص داخلی جهان را صد برابر یا بیشتر میکند. میتوان آیندهای را تصور کرد که در آن همزمان همه پیروز میشوند و منافعی کسب میکنند. با این حال تاکنون در جلب همکاری انسانها برای تحققبخشیدن به این آرمان بسیار ناموفق بودهایم.